Sitemize üye olarak beğendiğiniz içerikleri favorilerinize ekleyebilir, kendi ürettiğiniz ya da internet üzerinde beğendiğiniz içerikleri sitemizin ziyaretçilerine içerik gönder seçeneği ile sunabilirsiniz.

Zaten bir üyeliğiniz mevcut mu ? Giriş yapın

Sitemize üye olarak beğendiğiniz içerikleri favorilerinize ekleyebilir, kendi ürettiğiniz ya da internet üzerinde beğendiğiniz içerikleri sitemizin ziyaretçilerine içerik gönder seçeneği ile sunabilirsiniz.

Üyelerimize Özel Tüm Opsiyonlardan Kayıt Olarak Faydalanabilirsiniz

Sıradaki içerik:

Intel Çip Üretiminde TSMC Karşısında Büyük Darbe Aldı

- Anasayfa

- Uncategorized

- Haber

- Google, Yapay Zeka Güvenliğinde Yeni Dönemi Başlattı

Google, Yapay Zeka Güvenliğinde Yeni Dönemi Başlattı

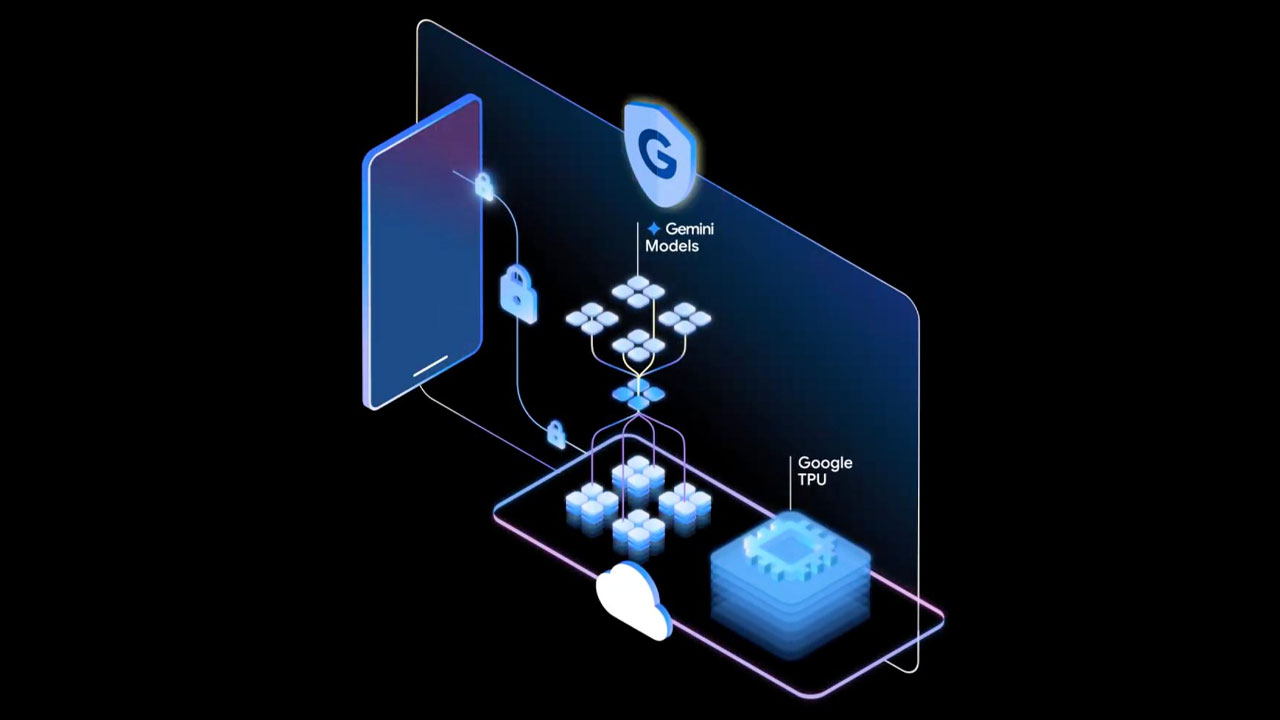

Google, yapay zekâ teknolojilerinin güvenli kullanımını artırmak için yeni bir küresel güvenlik girişimini duyurdu. Şirket, bu kapsamda hem Gemini modellerini hem de üçüncü taraf yapay zekâ sistemlerini kapsayan güçlü bir denetim ve doğrulama altyapısı oluşturuyor.

Google’dan Yapay Zeka Güvenliği Hamlesi

Yapay zekânın hızla gelişmesiyle birlikte, yanlış bilgi üretimi ve kötüye kullanım riskleri de artıyor. Google, bu riskleri azaltmak amacıyla “AI Safety Core” adını verdiği yeni güvenlik çerçevesini devreye soktu. Bu sistem, yalnızca Gemini gibi kendi modellerini değil, aynı zamanda yapay zekâyı entegre eden üçüncü taraf uygulamaları da kapsayacak şekilde tasarlandı.

Yeni yapay zekâ güvenlik sistemi; içerik denetimi, kullanıcı verilerinin korunması, etik üretim ilkeleri ve şeffaflık raporlaması gibi dört ana başlıkta toplanıyor. Google, ayrıca bu sistemin bir parçası olarak AI Transparency Center (Yapay Zeka Şeffaflık Merkezi) adlı bir portalı da aktif hâle getirdi. Burada geliştiriciler, hangi modelin nasıl eğitildiğini, veri setlerinin kapsamını ve güvenlik testlerinin sonuçlarını inceleyebiliyor.

Gemini Modellerine Ek Güvenlik Katmanı

Google’ın yeni politikası, özellikle Gemini 2.0 ve üstü modeller için geliştirilen “Responsible Mode” özelliğini de kapsıyor. Bu özellik, modelin ürettiği yanıtların gerçeklik doğrulamasını otomatik olarak yapıyor. Kullanıcıların yanlış bilgi veya manipülasyon içeren içeriklerle karşılaşma olasılığı bu sayede büyük ölçüde azaltılıyor.

Ayrıca, sistemin kötüye kullanımını önlemek için Gemini modellerine özel kapsamlı bir davranış izleme altyapısı da eklendi. Bu sistem, kullanıcı komutlarını gerçek zamanlı analiz ederek olası güvenlik ihlallerini önceden tespit ediyor.

Sektör Genelinde Etki Yaratacak

Google’ın yeni güvenlik yaklaşımı yalnızca şirket içi ürünlerle sınırlı kalmayacak. Şirket, bu güvenlik protokolünü açık standart hâline getirip, sektördeki diğer büyük firmalarla (örneğin Microsoft, Anthropic, OpenAI) paylaşmayı hedefliyor. Böylece küresel ölçekte yapay zekâ güvenliği konusunda ortak bir dil ve teknik standart oluşturulması planlanıyor.

Google yöneticilerine göre, yapay zekânın artık insan hayatının her alanına dokunduğu bir dönemde, “güvenli inovasyon” kavramı teknoloji yarışından daha önemli hâle gelmiş durumda.

- Site İçi Yorumlar

Hızlı Yorum Yap

Yorum Yaz